Google представила новую технологию памяти для искусственного интеллекта

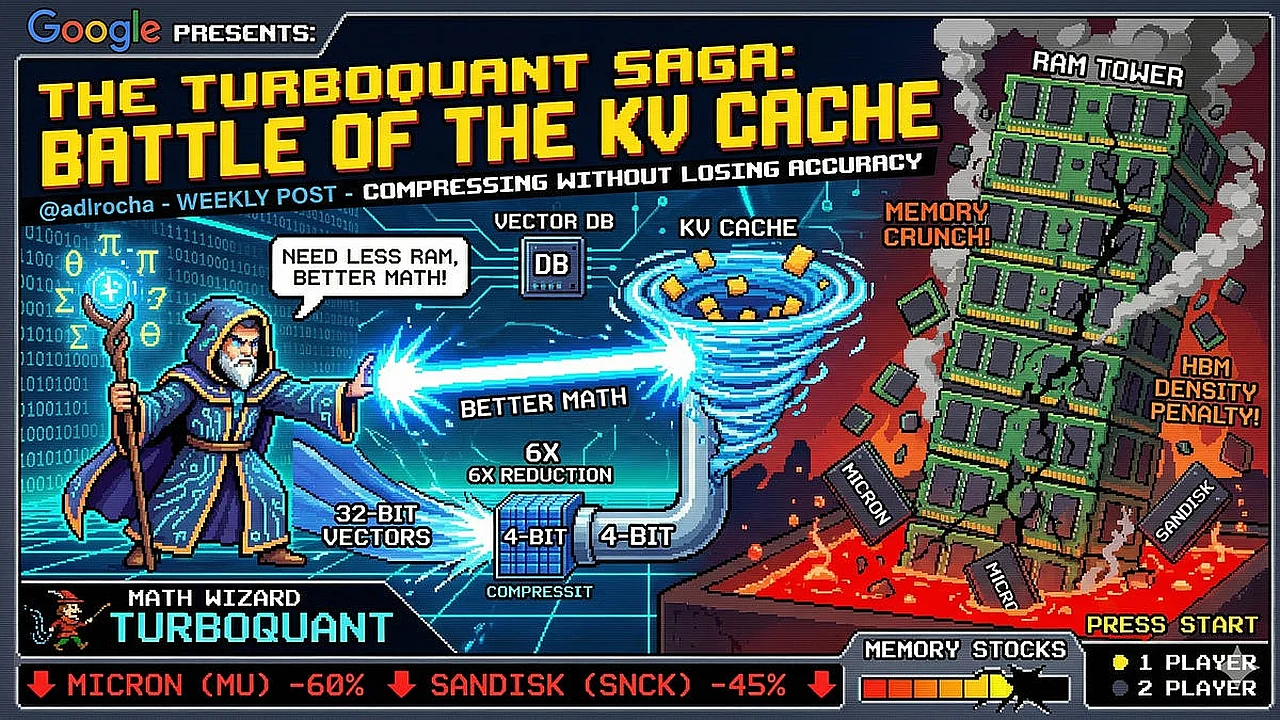

Компания Google представила новую технологию под названием TurboQuant. Об этом сообщает Zamin.uz.

Этот метод направлен на снижение требований к памяти, что является одной из самых больших аппаратных проблем систем искусственного интеллекта. Традиционно такие системы полагаются на большие и дорогие чипы, однако подход TurboQuant основан на сокращении объема данных, которые должны храниться в памяти во время генерации текста крупными языковыми моделями.

Это нововведение может иметь важное значение для компаний, разрабатывающих системы искусственного интеллекта, и инвесторов на рынке чипов памяти. В крупных языковых моделях при прогнозировании каждого нового слова или символа происходит повторный доступ к предыдущим данным.

Для этого данные ключей и значений из предыдущих этапов хранятся в специальном кэше. Этот кэш снижает количество повторных вычислений, но его объем увеличивается с добавлением каждого нового слова.

Особенно в длительных диалогах, процессах написания кода или анализе документов требования к памяти могут резко возрасти. TurboQuant снижает эти требования за счет сжатия данных именно в этом кэше.

По имеющимся данным, этот метод сжимает сохраняемые векторы, не нанося значительного ущерба точности модели. Проще говоря, он стремится использовать меньше физической памяти графического процессора, сохраняя при этом большие возможности памяти.

Это может повысить вычислительную эффективность и снизить нагрузку на обеспечение высокоскоростной памяти. Если методы, подобные TurboQuant, будут широко применяться с высокой эффективностью, это может изменить представления об инфраструктуре искусственного интеллекта.

Высокие требования к памяти могут сохраниться, однако ожидается, что технологии умного сжатия замедлят рост аппаратных потребностей. Это повысит роль программного обеспечения в отрасли и позволит решить часть проблем, которые ранее считались решаемыми только с помощью аппаратного обеспечения.